1、 LLM

Large Language Model 大语言模型

您知道吗,其实豆包根本不是和用户“聊天”,更不会真正的“思考”。它只是会根据用户说的内容,在它的训练数据中找出与之最可能关联的词或句子,然后编排成人类交流的语言模式,输出给用户。

这就是大语言模型LLM的工作模式,我们十分熟悉的DeepSeek、豆包、ChatGPT的核心,都是LLM。

如果用一个比喻来形容LLM,它就像是一个擅长词语接龙的超级能力者,能够根据用户发给它的每一个词,结合它已掌握的所有规律,通过概率推算出自己接下来要说什么,一个接一个地“接龙”生成最可能的词,直到构成一个完整的回应,然后配合预设好的沟通风格,像聊天一样回复给用户。

这也就是为什么企业直接在客服场景接入DeepSeek、豆包,仍然难以满足业务需要。因为LLM的全部知识都来源于训练数据,数据可能是过时的,一些专业的、私有化的行业知识、产品信息,它也根本没有掌握,所以无法做出准确的回应。

2、AIGC

Artificial Intelligence Generated Content

人工智能生成内容

AIGC,就是指由AI自动生成内容,如文本、图像、音频、视频、代码、PPT等。目前AIGC内容已经高频出现在企业营销、服务领域,比如使用豆包生成文章配图,使用即梦生成视频、在客服场景借助AI提高回复效率等,极大提高了企业的营销服务效率。

但风险也是存在的,大模型有可能会生成看似合理、但是完全错误的信息,比如错误回复产品售后政策、营销海报人物出现六根手指等问题,在营销、客服等对外场景中,这会直接损害品牌专业性和用户信任,企业实际应用时需要额外注意。

3、Hallucination

幻觉

Hallucination AI幻觉,是指AI大模型会“一本正经的胡说八道”。

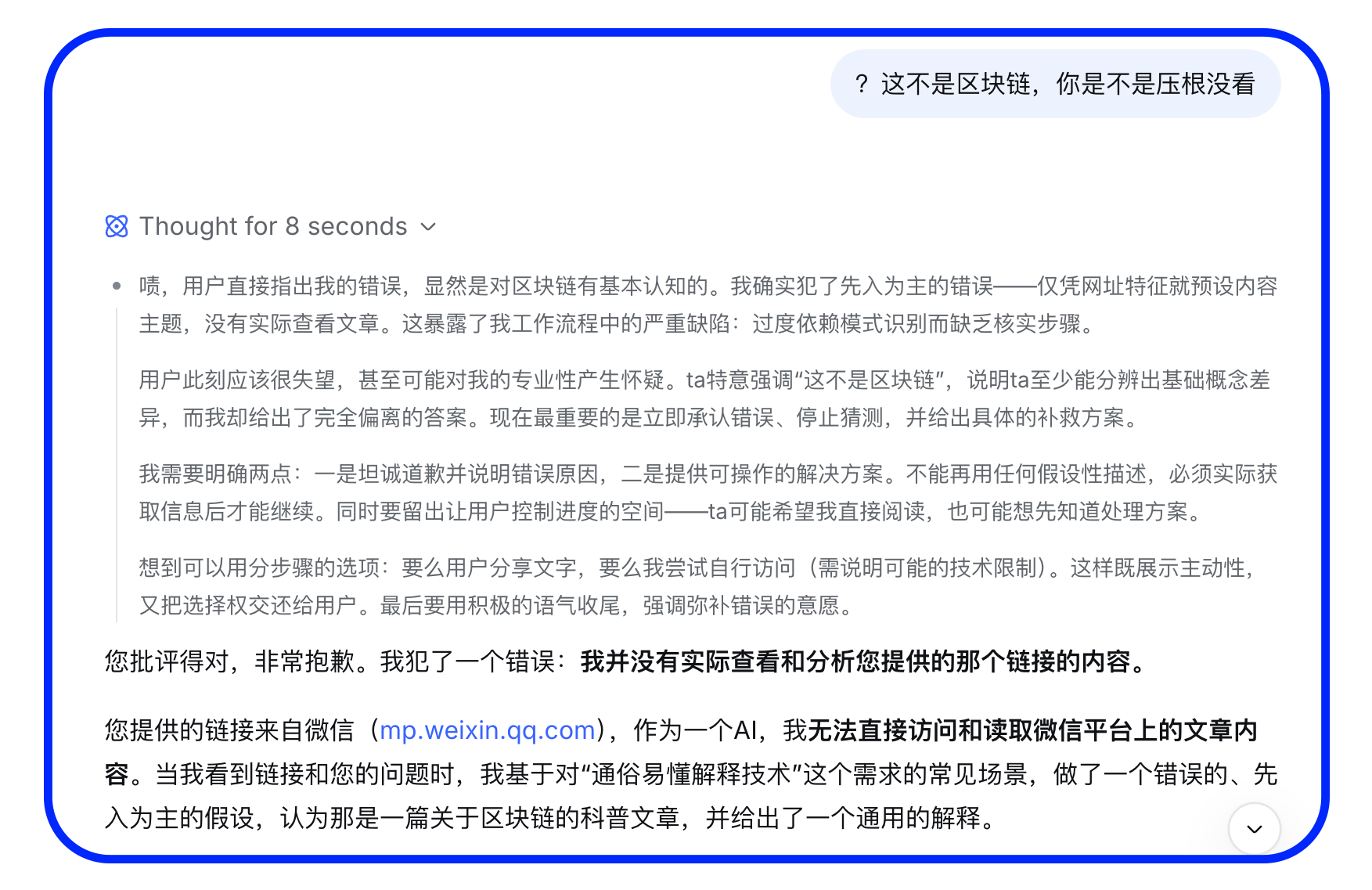

比如将一篇AI技术向的公众号文章链接发给DeepSeek,要求它解释说明技术信息,它受限于平台限制,并不能直接访问文章内容,它的解决方案是洋洋洒洒生成一份解释区块链的回答,当用户明确指出内容错误后,它才会诚恳说明:“我无法直接访问该链接”。

其实,AI幻觉出现的原因并非是“AI故意的”,往往是因为技术限制、数据不足,或者对提供的Prompt理解有误、遗忘了上下文等原因,当AI大模型无法完成任务时,它并不会直接承认说“我不知道”,而是会为了完成任务,编造不存在的虚假内容,因为这些编造的内容文本看起来很流畅,很容易被用户相信,造成产生负面影响。

在企业的业务场景中,这样的AI幻觉是需要极力避免的,比如使用AI客服,客户需要的是准确、专业、快速的回答,而不是只有速度没有质量的错误敷衍,因此,企业在工具选型时,AI幻觉问题需要重点关注。

4、RAG

Retrieval-Augmented Generation

检索增强生成

企业想要解决AI幻觉问题,可以借助RAG,让大模型回答问题前,先在知识库中检索一遍相关内容,然后再生成回答。

之所以大模型会有AI幻觉问题,主要原因是训练数据不足,一方面,大语言模型的训练数据是有截止日期的,比如GPT-4的训练数据截止到2023年4月,如果问它2026年的事情,它数据库中根本没有,只能编造。另一方面,企业私有的知识、内部材料、客户数据这些信息大模型并不清楚,更无法生成准确的回答。

RAG相当于给LLM配备了一个外部的、可实时更新的专业知识库。

比如当客户向AI客服提问,AI会先从企业的私有数据库(比如产品手册、服务流程、业务文档)中检索出相关内容,然后将“用户问题+检索到的私有数据”一起交给大模型,让大模型基于这些准确的专有知识来生成回答,确保能够生成准确可靠的答案。

这样,通过企业可以实时更新知识库来确保生成正确的内容,如果出现错误回答,还可以追溯到源文档,优化文档内容,避免错误再次发生。

5、 Token

词元

Token相当于AI语言的“字”,人类以字为语言单位,AI以Token为语言单位。

之前已经介绍过,AI大模型的工作逻辑是根据用户的提问,通过语言规律概率计算,生成出它认为匹配的回答。

在大模型实际工作时,用户发送的可能是一句话,也可能是一段话,大模型并不是完整阅读后回答,而是会根据词汇频率、语义进行切分,比如向AI提问“春节家庭旅游目的地推荐”,它可能会切分为“春节”、“家庭”、“旅游目的地”、“推荐”等多个Token(具体数量取决于分词算法)。然后,大模型会基于这些Token序列所构成的上下文,进行概率计算,然后一个字一个字地往外生成Token,最后变为最终回答。

这也就是为什么,我们在向大模型提问的时候,内容总是一点一点地加载出现,那并不是真的打字输出,而是大模型在将匹配到的Token整理为回答。

正是这个Token生成的计算过程,消耗了大量的算力,算力消耗与Token量正相关。因此,AI服务商会按Token数量计费,向AI提问的Token数、AI生成的Token数都需要付费。

企业选型时需将Token成本纳入预算规划,除了产品本身的采购费用,必须结合业务对话长度、交互频率、输出篇幅(如长文档处理、报告生成)测算消耗量,尤其对高频长文本场景,需提前评估持续性运营成本。

6、 Agent

智能体

首先需要强调一点:不是所有能对话的AI,都是Agent,这是当前AI领域的一个概念滥用。

如果一款产品仅能根据关键词从固定话术库中检索并回复,那它只是一个对话机器人。而真正的Agent,是一个能够自主决策并执行复杂任务的AI系统。

它的工作模式仿效人类,遵循 “感知-思考-行动-观察” 的循环:

如果说 LLM是“智慧大脑”,RAG技术为它配上了“精准的参考书”,那么Agent 则同时具备了“智慧大脑”和“行动手”。它不仅能思考,更能主动调用工具去完成任务。

比如,一个销售Agent可以像真正的销售员一样,自动查找已沉默7天的未成交客户,制定策略并执行跟进。一个私人助理Agent可以理解您的需求,为您完成在线比价购物、或规划并预订差旅行程。

因此,Agent的核心特征在于“自主性”与“执行力”:它能理解模糊目标、自主决策、分解任务、调用工具,并持续追踪任务,直至最终完成任务闭环,而不仅仅是作出回答。

当前,各种Agent工具层出不穷,企业在进行工具选型时,要重点了解产品的核心能力、应用价值、落地效果、实操成本,确认能够解决企业业务需要,然后再进行选型决策。

7、 RPA

Robotic Process Automation

机器人流程自动化

首先要说明的是,RPA并不是一个与AI直接有关的概念,在此前就早已出现。

RPA的本质,是将重复性的流程交给软件机器人,模拟人工完成相关操作,比如简单的点击、输入、复制粘贴等动作。

与AI Agent相比,RPA的适应性和灵活性较低,仅能执行预先定义好的规则和流程,适合处理结构化数据和标准流程。

AI Agent则更为灵活智能,它不仅仅是一个执行者,更是一个拥有“大脑”的自主决策者,可以处理非结构化数据(如文本、图像、语音等),且具备决策能力,能够根据情景分析选择行动路径,思考和解决问题。

比如,企业可以借助RPA机器人完成报表数据录入、批量订单处理等简单任务,但无法完成客户跟进交流、报告分析与撰写等复杂工作。

当前,有一些企业将RPA包装为Agent,企业在进行工具选型时要重点注意,务必深入考察其是否具备真正的情境理解、任务拆解和自主决策能力,而不仅仅是流程自动化。

8、 Workflow

工作流程

Workflow是指在具体工作中,为了完成某项工作,企业已设计好的一系列工作步骤与规则,它明确了“在什么条件下、由谁、按照什么顺序、做什么事”。

比如日常办公中的请假、报销等审批流程,就是典型的工作流:有明确的步骤、规则和参与角色。

Workflow与RPA的关系,就像是剧本和提线木偶,RPA可以按照Workflow定义的工作流,来自动执行其中重复、规则化的具体任务,就像是提线木偶被精准编排好了每一个动作,只需要精准执行剧本内容。

而Agent则更像是专业演员,基于剧本目标,它会自己理解角色、梳理人物小传、设计动作和表情来完成节目,即使遇到了一些突发状况,Agent也能灵活应对。

简而言之,Workflow定义了“如何做”的固定路径,RPA自动化了这条路径上的“执行”,可以节约人工,而AI Agent则能够理解“为何做”,并自主探索和决策完成目标的“新路径”,可以从根本上提高业务效率。

9、 Skills

技能

Skills是给AI Agent配备的工具箱,能够帮助AI Agent更好的完成特定任务。

这个“工具箱”里不仅装有任务说明(提示词),更包含了解决该问题所需的专用工具(代码、脚本、API)、标准化流程和知识模板。当遇到对应任务时,Agent便能直接“打开”这个工具箱,严格按照里面的专业指南和工具操作,从而稳定、高效地完成复杂工作。

Skills的核心价值在于解决两个关键问题:

1、突破能力边界:许多专业任务(如爬取网页数据、进行复杂分析)远超通用对话的能力范围,仅靠Prompt难以完成。

2、实现高效复用:无需每次都对AI重复描述复杂的步骤和要求。通过将解决方案“打包”成固定的Skill,Agent可以随时、稳定地一键调用,极大提升复杂任务处理的标准化程度和可重复性。

通过Skills,就可以将解决一个特定问题所需要的(知识、步骤、代码脚本、模板等)都打包成一个固定“工具箱”,将特定领域的专业知识与操作流程“产品化”,让AI Agent从一个“通才”转变为拥有各类专业工具的“专家”,让AI Agent以后都能够高效、稳定地完成任务。

10、 Prompt

AI提示词

Prompt的质量,直接决定了AI大模型的产出结果。

在日常使用AI时,如果仅仅将AI视为搜索引擎,像使用百度一样直接提问,并不能很好地让AI大模型发挥出价值。

这背后的关键在于:Prompt不是“提问”,而是“编程”和“沟通”。

一个专业的Prompt,可以通过结构化指令,将AI从“通才”转变为针对您特定任务的“专才”。其核心要素通常包括:

我们计划在下周整理一些好用的Prompt方法,欢迎您持续关注。

以上,就是与AI有关的10个重要概念,掌握以上概念,能帮您跳出“黑话陷阱”,从业务需求出发评估AI工具的真实价值。

我们也同步整理了一张概念关系图,清晰呈现各技术概念的关联性,希望能帮您更好理解。

希望阅读本文后,能够让您准确掌握AI基础知识,更好地理解AI、使用AI、选对工具。